Contents

脆弱性はAIが直す時代へ──AI駆動開発とDevSecOpsで何が変わるのか

開発スピードが年々上がる一方で、脆弱性対応のバックログは減るどころか増え続けています。SASTや依存関係スキャンを導入し、DevSecOpsとして「早く検知する」ことには成功していても、その先の修正は人手に依存しがちです。結果として、重要なプロダクトほど脆弱性の山が放置され、開発者とセキュリティ担当の双方が疲弊していきます。ここに登場してきたのが、AI駆動開発を前提にした脆弱性 自動修正というアプローチです。検出された問題に対し、AIがコードを読み解き、修正案を生成し、場合によってはテストとPR作成まで自動で進めることで、「見つかるだけで終わり」だった世界から「見つかった瞬間に直り始める」世界に移行させます。

GitHub Copilotや各種LLMの登場で、AI駆動開発そのものはすでに多くの組織に浸透しつつあります。しかし、AI駆動開発が大量のコードを生み出すようになるほど、セキュリティの負債は加速度的に増える可能性があります。ここで重要なのが、AI駆動開発とDevSecOpsを切り離さず、「AIがコードを書くなら、AIが脆弱性 自動修正まで担当する」という発想です。つまり、AI駆動開発をセキュアに運用するために、DevSecOpsの中にAIによる自動修復(オートリメディエーション)を組み込むわけです。

経営や改善担当の視点から見ると、AI駆動開発とDevSecOpsの組み合わせにより、いくつかの明確なメリットが期待できます。第一に、MTTR(平均修復時間)の短縮です。脆弱性 自動修正により、検知から修正PR作成までのリードタイムが自動化され、人が判断するのは「適用するかどうか」のレベルになります。第二に、セキュリティ事故リスクの低減です。DevSecOpsパイプラインの中にAI支援開発を組み込むことで、「気づかないまま放置される脆弱性」を減らし、見つけたものを確実に潰していくフローが構築できます。第三に、採用・教育コストの抑制です。すべてを熟練のセキュリティエンジニアに頼るのではなく、AI駆動開発を前提にDevSecOps導入を進めれば、既存メンバーでも一定レベルのセキュア開発を回せるようになります。

この記事では、AI駆動開発とDevSecOpsを組み合わせた脆弱性 自動修正の全体像から、実際のパターン、導入ロードマップ、効果測定、リスクとガバナンスまで、改善担当の方が現場で使えるレベルで整理していきます。「ツールを入れて終わり」ではなく、DevSecOps導入を成功させるための考え方や、AI支援開発をどう組織に根付かせるかを具体的にイメージしながら読み進めてみてください。

DevSecOpsパイプラインの中にAI駆動開発を組み込む考え方

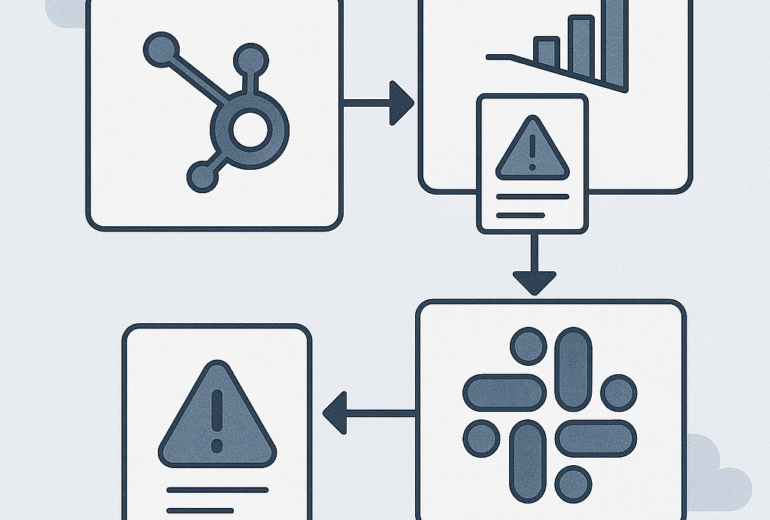

まず押さえたいのは、DevSecOpsとはあくまで「開発(Dev)・運用(Ops)・セキュリティ(Sec)を一体として回す文化と仕組み」であり、単なるツールの寄せ集めではないという点です。そのうえで、AI駆動開発をDevSecOpsに組み込むときは、「どこまでをAIに任せ、どこからを人間が見るか」をフローとして明確に分解する必要があります。典型的な流れは、コードの変更→CIでのビルド・テスト→SAST・依存関係スキャン→脆弱性検出→AIによる脆弱性 自動修正案生成→PR作成→レビュー→マージ、というパイプラインです。この中でAI駆動開発が担うのは、主に「原因の説明」「修正候補の生成」「差分の整形」といった部分になります。

どこまで自動化するかは組織ごとのリスク許容度に依存します。たとえば、テストが充実しているサービスでは、AI駆動開発により生成された修正をCI上で自動テストし、すべてのテストをパスした場合は「自動マージ」まで許容するDevSecOps導入も可能です。一方、ミッションクリティカルなプロダクトや、金融・医療など規制の厳しい領域では、脆弱性 自動修正はあくまで「PRの提案」に留め、必ず人間によるレビューと承認を必須とすることが多いでしょう。ここで重要なのは、「AI駆動開発にやらせる範囲」「DevSecOpsの中で人間が責任を持つ範囲」をポリシーとして明文化することです。

また、AI駆動開発をDevSecOpsに組み込む際には、ガードレールの設計が欠かせません。具体的には、AIが修正してよいファイルやディレクトリを限定する、ビジネスロジック層では自動修復ではなく提案のみ許可する、機密性の高いリポジトリはオフラインLLMや社内閉域のAI支援開発環境に限定する、といったルールを設けます。こうしたガードレールにより、DevSecOpsの「セキュア開発」という原則を守りつつ、AI駆動開発のスピードを享受できるようになります。

さらに、DevSecOps導入を成功させるうえでは、役割分担の再設計も重要です。従来はセキュリティチームが一つひとつの脆弱性を精査し、修正方針まで詳細に決めていたかもしれません。しかし、脆弱性 自動修正が前提になると、セキュリティチームは「ルールとポリシーの設計と監査」に役割をシフトし、開発チームはAI駆動開発が生成した修正PRをレビューして受け入れるスタイルに変わっていきます。DevSecOpsの成熟度が高い組織ほど、このような役割分担とフローが明確で、AI支援開発の導入もスムーズです。

Tips:AI駆動開発をDevSecOpsに組み込む時のチェックポイント

- AIが触ってよいコードの範囲は明確か(インフラ・設定・ビジネスロジックで線引き)

- DevSecOpsのパイプライン図に、AI支援開発のステップが描かれているか

- 「AIの提案を採用した変更」を後から追跡できるログやタグが用意されているか

3分でできる! 開発費用のカンタン概算見積もりはこちら

実践パターン:GitHub・Snyk・GitLabに見る脆弱性 自動修正の現場

次に、実際のツールがどのように脆弱性 自動修正を実現しているかを見ていきます。ここでは、AI駆動開発とDevSecOpsを強く意識した3つの代表的なパターンを紹介します。1つ目は、GitHubのコードスキャン(CodeQL)とCopilotを組み合わせたパターンです。CodeQLが脆弱性を検出すると、その結果をもとにCopilotが修正案を生成し、開発者はPR上で「この脆弱性は何か」「なぜ危険か」「どのような修正が提案されているか」を自然言語とコードで確認できます。これはまさにAI駆動開発によるオートリメディエーションであり、DevSecOpsのパイプラインに自然に組み込めるスタイルです。

2つ目は、Snykに代表される依存関係の自動修復です。OSSライブラリの脆弱性が検出されると、Snykは最適なバージョンへのアップデートパスを計算し、変更内容を含んだPRを自動作成してくれます。ここに最新のAI駆動開発機能を組み合わせると、単なるバージョンアップだけでなく、「破壊的変更に伴うコードの書き換え」まで自動提案できるようになります。依存関係周りの問題は、開発者にとって心理的ハードルが高い部分ですが、DevSecOpsのパイプラインで「放っておいてもAIが自動修復してくれる」という状態に近づけられれば、セキュリティ負債の多くを継続的に削減できます。

3つ目は、GitLab Duoのように、セキュリティダッシュボードとMR(Merge Request)を密接に連携させるパターンです。脆弱性レポートから直接「修正MRを作成」できるようにし、そのMRの中でAI駆動開発が修正コードと説明を生成します。レビュー担当者は、MRの画面だけを見れば、どのDevSecOpsスキャンで検出されたか、どのような脆弱性 自動修正が行われたか、その結果どのテストが通っているかを一望できます。これは、セキュリティチームと開発チームが同じコンテキストで会話できるという意味で、非常に実務的なDevSecOps導入パターンです。

これらの事例から学べるのは、「AI駆動開発の機能だけを見てツールを選ぶのではなく、自社のDevSecOpsパイプラインの中でどう溶け込むか」を重視することです。同じ脆弱性 自動修正でも、「PR単位で扱うのか」「チケット起票とセットにするのか」「どの権限でマージまで許可するのか」によって、開発体験もリスクプロファイルも大きく変わります。改善担当としては、これらのパターンを参考にしながら、自社の文化に合うAI支援開発とDevSecOps導入方針を設計することが求められます。

ポイント:ツール比較の前に「自社の理想フロー」を描く

先にDevSecOps全体のフローと、AI駆動開発にやらせたい脆弱性 自動修正の範囲を図にし、そのうえでGitHubやSnyk、GitLabなどの機能を当てはめていくと、検討がスムーズになります。

導入ロードマップ:PoCから本番DevSecOps運用に載せるまで

脆弱性 自動修正を現場に根付かせるには、いきなり全リポジトリに適用するのではなく、きちんとしたロードマップが必要です。ここでは、AI駆動開発とDevSecOps導入を組み合わせたステップを、実務の流れとして整理します。まずステップ1として、対象の絞り込みです。すべてのサービスにAI支援開発を適用しようとすると、ルール設計が破綻しがちです。そこで、内部向けツールや限定ユーザー向けの機能など、リスクが比較的低く、かつ脆弱性の発生頻度が高い領域を「PoC対象」として選定します。

ステップ2では、PoCの成功指標を定義します。具体的には、対象範囲におけるMTTRの変化、月あたりの解消件数、AI駆動開発による修正PRのレビュー承認率、ロールバック率などです。これらをDevSecOpsダッシュボードに載せ、導入前後を比較できるようにします。同時に、「AIが提案したが却下された修正」の理由も収集しておくと、脆弱性 自動修正のルールやプロンプト設計を改善する材料になります。

ステップ3は、CI/CDへの組み込みです。SASTや依存関係スキャンのジョブの後に「AI自動修復ジョブ」を追加し、問題が検出された場合に自動でブランチ作成・修正コミット・PR作成まで行うようにします。このとき、AI駆動開発の処理時間が長くなりすぎると全体のDevSecOpsパイプラインが遅くなるため、「高優先度の脆弱性のみAIで即時自動修復」「低優先度はバッチでまとめてPR生成」などの運用ルールも検討すると良いでしょう。

最後のステップ4では、本番運用への展開とガバナンス整備を行います。PoCで得られた知見をもとに、DevSecOps全体のポリシー文書を更新し、「どのシステムに脆弱性 自動修正を有効化するか」「どのレベルの脆弱性は人間の承認なしにマージしてよいか」「AIが触れてよい設定ファイル・インフラコードの範囲はどこまでか」などを明文化します。さらに、監査ログの保存期間、AIが生成したコードの識別方法、インシデント発生時の調査手順も定めておけば、AI駆動開発とDevSecOps導入を安心してスケールさせることができます。

社内説明で使える一言

「AI駆動開発とDevSecOpsを組み合わせた脆弱性 自動修正は、いきなり本番全体に広げるものではなく、PoCで効果とリスクを測りながら対象を広げていく“継続的改善プロジェクト”です。」

3分でできる! 開発費用のカンタン概算見積もりはこちら

効果測定とダッシュボード設計:AI駆動開発を数字で語る

改善担当にとって、AI駆動開発やDevSecOps導入の良し悪しを判断するうえで最も重要なのは、「経営層や現場リーダーに対して、数字で説明できるかどうか」です。脆弱性 自動修正の効果を測るためには、導入前後で比較可能なKPIの設計が必須になります。代表的なKPIは、MTTR(平均修復時間)、一定期間あたりの脆弱性解消件数、未対応チケット数の推移、再発率、本番障害との関連性などです。AI駆動開発による修正PRと、人手による従来型PRを区別してカウントすることで、「DevSecOpsパイプラインの中でAIがどれだけ貢献しているか」を明確に示せます。

ダッシュボードの設計では、「単にグラフを並べる」のではなく、意思決定につながる構造を意識します。たとえば、上段にDevSecOps全体のKPI(全脆弱性件数・MTTR・再発率)、中段にAI駆動開発による脆弱性 自動修正のKPI(AI生成PR数・承認率・テスト通過率)、下段にチーム別の詳細(サービスごとのトレンドやボトルネック)を配置すると、経営会議では上段を、現場では中段と下段を主に見る、といった使い分けができます。また、「AIが提案したが却下された修正」の理由を定性情報として集約し、ダッシュボードからリンクされるレポートにまとめておくと、プロンプト設計やルール設定の改善に役立ちます。

もう一つ重要なのが、「AI駆動開発とDevSecOps導入により、どれだけセキュリティ負債が減ったか」を示す指標です。たとえば、「CVSSスコア7以上の高リスク脆弱性が何日で解決されたか」「同種の脆弱性が何回再発したか」「脆弱性 自動修正により人手での対応工数がどれだけ削減されたと見積もれるか」といった視点です。これらを報告書や経営向け資料で共有することで、「AI支援開発に投資する価値がある」という納得感を醸成できます。

ダッシュボードで押さえたい3つの軸

- スピード:MTTR、検知からPR作成までの時間、DevSecOpsパイプラインのリードタイム

- 品質:テスト通過率、ロールバック率、本番障害との関連

- 負荷:レビュー工数、AI駆動開発による自動修復PRの件数と比率

リスクとガバナンス:安全なAI支援開発とDevSecOps導入の条件

最後に、AI駆動開発と脆弱性 自動修正を安全に運用するためのリスクとガバナンスについて整理します。最大のリスクは、「AIの修正が仕様意図を損ない、別の不具合やセキュリティリスクを生む」ことです。DevSecOpsの観点から見ると、「検知した脆弱性は消えたが、別の攻撃経路を開いてしまった」といった事態は絶対に避けなければなりません。そのため、ビジネスロジックやデータ整合性に影響する箇所は、AI支援開発による自動修復ではなく「提案止まり」にし、人間によるレビューを必須とすることが基本方針になります。

また、AIにコードを渡すこと自体のリスクも見逃せません。社外のLLMサービスを利用する場合、機密情報や個人情報を含むコードが外部に送信される可能性があります。これを避けるためには、社内閉域で動作するAI支援開発基盤の利用や、マスキング・トークナイズなどの前処理、あるいは「このリポジトリはAIに渡してはいけない」というゾーニングを行う必要があります。DevSecOps導入のポリシーとして、「AIに渡せる情報」「渡してはいけない情報」を明文化し、ツール側の設定や権限で強制することが重要です。

さらに、LLM自体の脆弱性やプロンプトインジェクションなど、新しい種類のリスクも登場しています。たとえば、テストコードやコメントに悪意ある文言が紛れ込み、AI駆動開発の判断を誤らせるといったシナリオです。こうしたリスクに対しては、AIが生成した変更に特定のタグやコメントを付与しておき、一定期間は重点的にモニタリングする、DevSecOpsチームが定期的にサンプリングレビューを行う、といった運用が有効です。

改善担当としては、これらのリスクを踏まえたうえで、「AI駆動開発とDevSecOps導入をどう設計すれば、全体としてのリスクを下げつつ、脆弱性 自動修正によるメリットを最大化できるか」を考える必要があります。その際、社内だけで完結させるのが難しければ、外部パートナーと協力するのも有力な選択肢です。次のまとめでは、株式会社ソフィエイトとしてどのような支援が可能かを含め、検討のとっかかりとなるポイントを整理します。

3分でできる! 開発費用のカンタン概算見積もりはこちら

まとめ:小さく始めて継続的に育てる「AI×DevSecOps」の変革

本記事では、AI駆動開発とDevSecOpsを組み合わせた脆弱性 自動修正の考え方、具体的なツールパターン、導入ロードマップ、効果測定、リスクとガバナンスまでを概観しました。共通していたポイントは、「AIさえ入れればすべて自動で解決する」という魔法は存在せず、あくまでDevSecOpsの一部としてAI支援開発を設計し、ガードレールとKPIを整えることで初めて現場で使える仕組みになる、ということです。AI駆動開発により修正PRが自動生成されるようになっても、それをどの範囲で受け入れ、どの範囲で人間がレビューするかを決めるのは組織のガバナンスです。

一方で、うまく設計・運用できれば、脆弱性 自動修正は開発組織に大きなインパクトをもたらします。MTTRの短縮、バックログの圧縮、セキュリティインシデントリスクの低減に加えて、開発者が「修正作業」から解放され、本来の価値創造に時間を使えるようになります。DevSecOps導入に悩む組織にとって、AI駆動開発は単なる流行ではなく、「限られたリソースでセキュリティと生産性を両立するための現実解」として位置づけられるでしょう。

株式会社ソフィエイトでは、単に「ツールを導入しましょう」と提案するのではなく、現状のDevSecOpsの成熟度や開発プロセス、セキュリティポリシーを丁寧にヒアリングしたうえで、「どの範囲からAI駆動開発と脆弱性 自動修正を始めるべきか」「どのようなダッシュボードやKPIで効果を測るべきか」「リスクとガバナンスをどう設計すべきか」を一緒に検討していきます。小さなPoCから始めて、成功体験をもとに段階的にDevSecOpsを強化していく──そんな伴走型の支援が可能です。

無料相談でできること

- 自社のDevSecOpsの現状診断と、AI駆動開発を組み込む優先領域の整理

- 脆弱性 自動修正のPoC計画(対象システム・KPI・期間)のたたき台作成

- 経営・情報システム部門向けの説明資料(投資対効果・リスク整理)の構成支援

「まずは自社の状況を聞いてほしい」という段階でも構いません。AI支援開発とDevSecOps導入をどこから始めるべきか、一緒に整理していきましょう。

株式会社ソフィエイトのサービス内容

- システム開発(System Development):スマートフォンアプリ・Webシステム・AIソリューションの受託開発と運用対応

- コンサルティング(Consulting):業務・ITコンサルからプロンプト設計、導入フロー構築を伴走支援

- UI/UX・デザイン:アプリ・Webのユーザー体験設計、UI改善により操作性・業務効率を向上

- 大学発ベンチャーの強み:筑波大学との共同研究実績やAI活用による業務改善プロジェクトに強い

コメント