Contents

「社員のリテラシー頼み」から脱却する社内AIの守り方

ChatGPTや社内用のAIチャットボットを導入する会社が増える一方で、「便利だけど、本当に情報漏えいは大丈夫なのか」「社員任せの運用でいいのか」という不安も広がっています。多くの企業では、まず「利用規程」や「教育」に力を入れますが、それだけでは限界があります。事故の多くは、悪意よりも「うっかり」や「よかれと思って」が原因だからです。

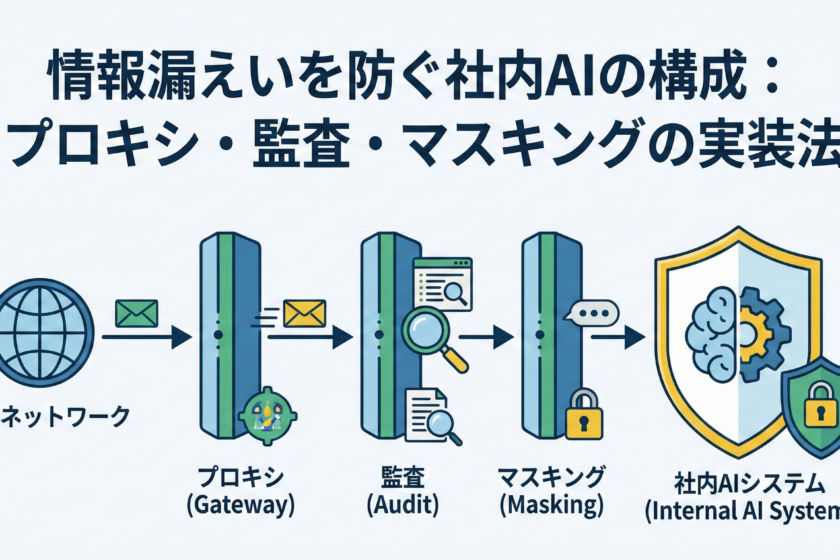

そこで重要になるのが、技術的なガードレールを組み込んだ社内AIの構成です。本記事では、AIやITに詳しくない中小企業の経営者・情報システム担当者でもイメージしやすいように、「プロキシ」「監査ログ」「データマスキング」を組み合わせたアーキテクチャの考え方と、段階的な導入ステップを解説します。ポイントは、「社員の良心に頼る」のではなく、「そもそも出してはいけない情報は出ていかない構成」にしてしまうことです。

3分でできる! 開発費用のカンタン概算見積もりはこちら

なぜ「社内AIの構成」で情報漏えいリスクが変わるのか

同じ生成AIを使っていても、社内AIの構成次第で情報漏えいリスクは大きく変わります。社員が各自のブラウザからインターネット経由で外部のAIサービスに直接アクセスしている場合、会社としては「誰が・いつ・何を入力したのか」が分かりません。入力内容のチェックも、ログの記録もできず、問題が起きても追跡が困難です。

一方で、すべてのAIトラフィックを一度受け止める「関所」を設け、その中でフィルタリングと記録を行う構成にすれば、状況は一変します。具体的には、プロキシで不要な情報をブロックし、監査ログを残し、必要に応じてデータマスキングで個人情報などを伏せてから外部のモデルに送るイメージです。

ポイント:教育と規程は「最後の防波堤」、構成は「最初の防波堤」です。

どれだけ教育しても、人はミスをします。だからこそ、構成そのものを安全側に振ることが重要になります。

リテラシー教育はもちろん大切ですが、「そもそも入力できない」「入れてもマスクされる」「ログに残る」といった構成を用意することで、現場の不安を和らげつつ情報漏えいリスクを現実的なレベルまで下げることができます。

情報漏えいを防ぐ社内AIアーキテクチャの全体像

まずは全体像をイメージしましょう。典型的な構成は次のようになります。

ユーザーのPCやスマホから、社内ネットワークやVPNを経由して、社内ポータルや社内用ChatGPTの画面にアクセスします。このポータルの裏側にプロキシ構成があり、そこがすべてのAIリクエストを一度受け止める役割を担います。そのうえで、外部の生成AIサービスや自社でホストするモデルに中継します。

このとき重要なのが、ID基盤とログ基盤との連携です。シングルサインオンなどを使って「誰がアクセスしているか」を明確にし、その情報と紐づけて利用履歴を記録します。さらに、「社内から外に出ていく情報」と「外から返ってくる情報」を切り分けて設計します。前者にはフィルタリングやデータマスキングを適用し、後者はどこまで保存・再利用するかをルール化します。

すべてをスクラッチで作ろうとすると大変ですが、最近はAI向けのゲートウェイやプロキシをSaaSとして提供するサービスも増えています。社内AIの土台はそういったサービスに任せ、自社固有のルールや画面、ワークフローだけをカスタマイズする方が、中小企業にとっては現実的な選択肢です。

3分でできる! 開発費用のカンタン概算見積もりはこちら

プロキシ構成で実現するアクセス制御とNGワードブロック

プロキシ構成は、「社内から外部のAIへ向かうすべての通信が通る関所」です。この関所を一箇所に集約することで、次のようなことができるようになります。

- 部署・役職ごとに「どのAIサービスを使えるか」を制御する

- 利用できるモデルや機能を制限する(例:画像生成は特定部署のみ)

- リクエストの回数や時間帯をコントロールする

加えて、プロキシの段階で入力内容をチェックし、特定のキーワードやパターンにマッチした場合はブロックすることもできます。例えば、顧客名リストや特定のプロジェクトコード、個人番号などを「NGワード」として登録しておき、それを含むリクエストは送信前に止める、といったイメージです。

ブロックするだけでなく、ユーザーに対して「この情報はAIに送信できません」「社内AIで扱える範囲を確認してください」とメッセージを返せば、単なる監視ではなく、学びの機会にもなります。こうした仕組みは自前開発も可能ですが、すでに社内AI向けのゲートウェイサービスとして提供されているものを利用すれば、導入ハードルを下げられます。

監査ログとモニタリング設計:誰が・いつ・何を投げたか

監査ログは、「何かあったときに遡れるようにする」だけでなく、「そう簡単には変なことができない」という抑止力の役割も果たします。最低限、次のような情報は残しておきたいところです。

- ユーザーID・部署

- アクセス元IP・端末情報(可能な範囲で)

- 日時・利用したサービス/モデル名

- 入力・出力の全文または要約(保存ポリシーに応じて)

全文を保存するかどうかは、プライバシーや容量とのバランスになります。人事評価などに使われる不安を避ける意味でも、「ログはあくまでセキュリティとトラブル対応のために使う」「個人評価には利用しない」といった方針を明示しておくとよいでしょう。

ログは溜めるだけでなく、 定期的なチェックとアラートの仕組みが重要です。例えば、「深夜帯に大量のリクエストが発生した」「特定の機密プロジェクト名が短時間に何度も登場した」といった場合にアラートを上げる設定をしておきます。情報システム部門が一次対応し、必要に応じて現場の管理職と連携する、といった役割分担を決めておくことで、社内AIの監査体制が回りやすくなります。

3分でできる! 開発費用のカンタン概算見積もりはこちら

データマスキングと前処理で「出してはいけない情報」を守る

データマスキングは、「AIに文脈は渡したいが、具体的な個人情報や機密情報は渡したくない」というときに有効な手段です。社内AIにリクエストが届いたら、外部のモデルに送る前に、「前処理サービス」で個人名・住所・メールアドレス・顧客IDなどを自動で伏せる仕組みを入れます。

実装の方法はいくつかあります。電話番号やメールアドレスのようにパターンが分かりやすいものは、正規表現で検出してマスクすることができます。社員名や顧客名は、社員マスタや顧客マスタを辞書として持ち、それにマッチしたテキストを「顧客A」「社員B」のような記号に置き換えます。より高度な環境であれば、機械学習を用いて固有表現を検出し、リストにない固有名詞もマスクすることが可能です。

ログの保存時にもデータマスキングを適用しておくと、「ログが流出したときの被害」を大きく減らせます。ただし、マスクしすぎるとAIが文脈を理解できなくなり、「業務に使えない回答」ばかりになってしまうリスクもあります。最初は保守的に設定しつつ、実際の利用状況を見ながら、「これはマスクしなくても問題ない」「ここはマスクを強化しよう」と調整していくのが現実的です。

段階的な導入ステップと中小企業での現実解

ここまでの仕組みを一気に入れようとすると、時間もコストもかかりすぎます。特に人員の限られた中小企業では、「段階的にレベルアップしていく」発想が欠かせません。おすすめのステップは、次のような流れです。

- ステップ1:生成AI利用規程+簡易なログ取得

まずは利用規程を整備し、社内ポータルや社内AIからの利用に限定します。同時に、「誰がどれくらい使ったか」が分かるレベルでのログを取り始めます。 - ステップ2:AI向けプロキシの導入と権限管理

続いて、AI専用のゲートウェイやプロキシサービスを導入し、部署ごとの利用制限やNGワードブロックを実装します。ここまで来ると、「最低限の安全な利用」のラインが見えてきます。 - ステップ3:データマスキングと監査の高度化

最後に、重要度の高い業務についてデータマスキングや詳細な監査ログを導入し、インシデント対応や定期監査の体制を整えます。

このようにステップを分けることで、「まずはルールとログから」「次に構成を固める」「最後に高度な対策を追加する」と優先順位をつけられます。既存のVPN、ID管理、ログ基盤をうまく活用すれば、新たな投資を最小限に抑えつつ社内AIの安全性を高めることも可能です。

自社だけで構成設計から実装までを行うのが難しい場合は、AIシステムとセキュリティの両方に明るい外部パートナーに相談するのも現実的な選択肢です。その際、「どの業務で何を守りたいか」「既存インフラは何があるか」を事前に整理しておくと、短時間の打ち合わせでも具体的な構成案まで落とし込みやすくなります。

3分でできる! 開発費用のカンタン概算見積もりはこちら

まとめ:守りを固めてこそ、社内AIは本気で攻めに使える

本記事では、社内AIを安全に活用するための構成として、「プロキシ」「監査ログ」「データマスキング」を組み合わせたアーキテクチャの考え方を紹介しました。社員のリテラシーだけに頼るのではなく、構成そのものを安全側に振ることで、情報漏えいリスクを現実的なレベルまで下げることができます。

重要なのは、「完璧を目指して止まってしまう」のではなく、「まずはできる範囲から守りを固めていく」ことです。利用規程とログから始め、プロキシ構成で関所を作り、必要に応じてデータマスキングや高度な監査ログを追加する。こうした段階的なアプローチを取れば、中小企業でも無理なく安全な社内AI基盤を育てていくことができます。

守りが固まれば、「もし漏れたらどうしよう」という不安から解放され、社内AIを本気で攻めに使えるようになります。業務プロンプトの標準化、PoCの拡大、KPIによる費用対効果の可視化など、次の一手に踏み出すための土台として、まずは自社の社内AI構成を見直してみてください。

株式会社ソフィエイトのサービス内容

- システム開発(System Development):スマートフォンアプリ・Webシステム・AIソリューションの受託開発と運用対応

- コンサルティング(Consulting):業務・ITコンサルからプロンプト設計、導入フロー構築を伴走支援

- UI/UX・デザイン:アプリ・Webのユーザー体験設計、UI改善により操作性・業務効率を向上

- 大学発ベンチャーの強み:筑波大学との共同研究実績やAI活用による業務改善プロジェクトに強い

を雛形から作る方法-770x520.png)

-770x520.png)

-770x520.png)

コメント